Pouvez-vous nous donner une définition de l’holographie ?

Un affichage holographique est un affichage qui utilise la diffraction de la lumière pour créer une image tridimensionnelle virtuelle d’un objet. Les écrans holographiques sont uniques par rapport aux autres formes d’imagerie 3D, en ce sens qu’ils ne nécessitent pas de lunettes pour que le spectateur voie l’image. L’affichage holographique permet tous les degrés de liberté, il autorise le spectateur à se déplacer et à regarder la scène et ses objets sous n’importe quel angle. La technologie fournit à chaque globe oculaire la vue exacte de l’objet ; le cerveau ne perçoit pas que la scène n’est pas réelle car même un léger mouvement de la tête produit un effet stéréo parfait, ce que ne peut produire le cinéma 3D aujourd’hui.

Pour certains, la projection de la lumière laser sur de la fumée ou de la poussière holographique s’apparente déjà à de l’holographie, mais sa portée, son espace colorimétrique et sa résolution restent très limités. Le graal en matière d’holographie reste un écran présentant à chacun de vos yeux ce que vous verriez exactement si l’objet visualisé était vraiment là.

Comment crée-t-on une image holographique ?

Les images holographiques peuvent être créées de quatre manières différentes : tout d’abord, on peut capturer des données volumétriques grâce à des outils natifs, et de plus en plus d’acteurs du secteur offrent cette possibilité. Deuxièmement, on peut utiliser des outils logiciels pour obtenir des données volumétriques à partir d’images capturées par d’autres méthodes. Troisièmement, des contenus en 2D peuvent être enrichis d’une dimension volumétrique et convertis en images holographiques. Et enfin, on peut tout simplement créer des images holographiques de synthèse, par exemple dans le cadre de jeux vidéo ou d’applications d’effets visuels.

La conversion entièrement automatisée d’images plates en images volumétriques est possible dans une certaine mesure pour passer de la 2D à la 3D stéréoscopique, même s’il manque toujours une dimension humaine, artistique. Pour les images holographiques, le même type de procédure est envisageable, la qualité dépendra généralement de la quantité de métadonnées disponibles.

Chez Light Field Lab, nous nous concentrons avant tout sur les outils natifs, nous mettons à la disposition des créateurs de contenus 3D des plugs-in qui leur permettront de créer eux-mêmes des contenus holographiques sans bousculer leurs habitudes, qu’ils utilisent des outils comme Unity, Unreal ou encore Maya…

Quelles sont les ambitions de Light Field Lab ?

Nous avons commencé à développer des caméras holographiques fondées sur la technologie plénoptique ; celles-ci enregistraient une énorme quantité de données, mais sans rien pour les afficher… C’est comme si nous avions inventé la caméra en couleurs, alors qu’il n’existe encore que des écrans en noir et blanc !

Il nous est donc apparu primordial de développer un véritable écosystème holographique de bout en bout et nous sommes actuellement dans une phase « pré-produit » pour les écrans. Il faudra encore attendre encore un peu, mais nous travaillons déjà avec des studios très enthousiastes à l’idée de créer des contenus pour les affichages holographiques, comme ce projet d’Endeavour et Roddenberry Entertainment qui recrée le célèbre « holodeck » de l’univers Star Trek en collaboration avec OTOY, notre partenaire technologique pour la capture, le rendu et la diffusion holographique en streaming.

Quelle est votre approche technologique ?

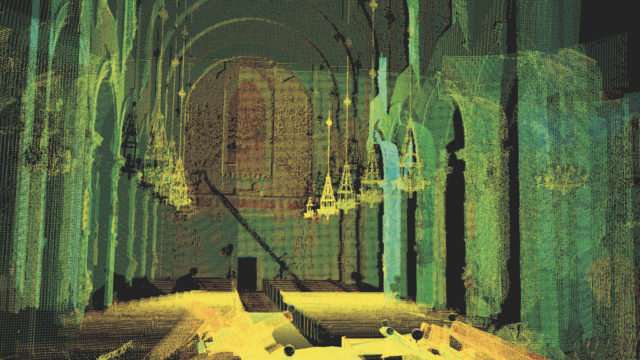

Les affichages holographiques sur lesquels nous travaillons se composent de panneaux émissifs qui projettent des faisceaux composés de multiples rayons lumineux, créant dans l’espace un volume sur lequel le regard du spectateur peut se fixer. Le panneau émissif possède un guide d’onde, qui forme des faisceaux très denses et hautement localisés. Grâce à ce guide d’ondes et à une couche de nanoparticules pour contrôler la résolution, nous apportons une réponse concurrentielle. Nous sommes en phase de prototype alpha et nous comptons à terme développer une solution adaptée pour les salles de cinéma.

Pouvez-vous nous en dire plus sur l’alliance IDEA que vous avez présentée sur le NAB 2019 ?

L’Immersive Digital Experiences Alliance (IDEA) est une alliance qui permettra de proposer une famille de spécifications techniques libres de droits pour l’holographie et ainsi de définir des interfaces interopérables et des formats d’échange qui pourront prendre en charge le transfert de bout en bout de champs immersifs volumétriques et/ou lumineux. Cette alliance a l’ambition de proposer une compatibilité avec un grand nombre d’affichages, ceci à partir d’une vision commune à tous ses membres fondateurs.

Les contenus holographiques représentent aujourd’hui plusieurs téraoctets de données par seconde, le but d’IDEA est notamment de trouver un moyen de vectoriser et d’encapsuler ces contenus en vue d’une transmission sur des réseaux grand public.

En 2018, Khosla Ventures et Sherpa Capital, avec la participation de R7 Partners ont investi 7 millions de dollars dans les développements de Lighfield Lab. Ce capital d’amorçage a été obtenu à partir de la présentation de modules prototypes de 6 x 4 pouces qui projettent des images dans un espace 3D avec une résolution de 16K x 10K. Cet été, une nouvelle levée de capitaux a permis à la société de récupérer 28 millions de dollars à l’initiative de Bosch Venture Capital et Taiwania Capital. Les nouveaux investisseurs sont : Samsung Ventures, Verizon Ventures, Comcast, Liberty Global Ventures et NTT Docomo Ventures , Inc. et HELLA Ventures, et les investisseurs Khosla Ventures, Alumni Ventures Group, R7 Partners et Acme Capital.

Article paru pour la première fois dans Mediakwest #33, p.70. Abonnez-vous à Mediakwest (5 numéros/an + 1 Hors-Série « Guide du tournage ») pour accéder, dès leur sortie, à nos articles dans leur intégralité.